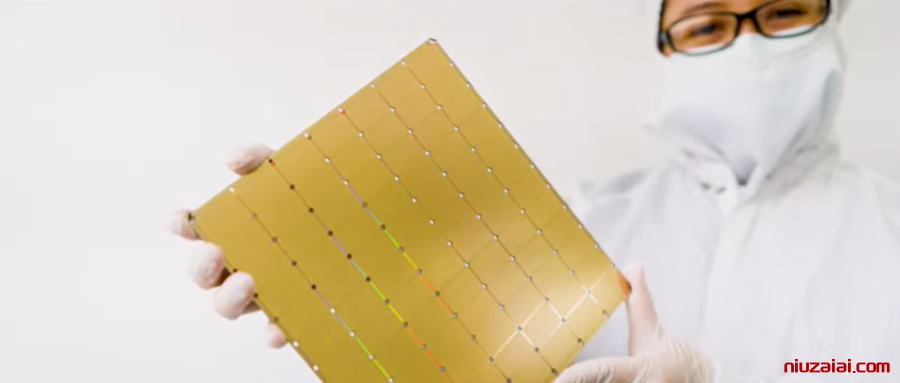

2024 年 3 月,美国芯片初创公司 Cerebras Systems 正式发布第三代晶圆级 AI 加速芯片WSE-3(Wafer Scale Engine 3)。作为目前全球规模最大、性能最强的 AI 芯片,WSE-3 以 4 万亿晶体管、125 petaFLOPs 的峰值算力和独特的架构设计,重新定义了大模型时代的算力标准。

![图片[1]-Cerebras 发布全球最大 AI 芯片 WSE-3-牛仔AI](https://niuzaiai.com/wp-content/uploads/2025/03/image-47.png)

一、技术参数与创新突破

- 极致规模与工艺

- 5nm 制程:采用台积电 5nm 工艺,集成 4 万亿个晶体管(前一代 WSE-2 为 2.6 万亿),核心数量增至 90 万个,片上 SRAM 达 44GB,硅片面积约 462.25 平方厘米(接近 12 英寸晶圆)。

- 单芯片架构:突破传统切割工艺,将整个晶圆作为单一芯片,显著减少数据传输延迟,提升能效比。

- 性能跃升

- 算力密度:峰值 AI 算力达 125 petaFLOPs(FP16),是英伟达 H100 GPU 的 62 倍,且功耗与前一代持平。

- 训练效率:单芯片可支持 24 万亿参数模型训练(约为 GPT-4 的 10 倍),700 亿参数的 Llama 模型训练仅需 1 天。

- 系统级优化

- 液冷设计:采用液体冷却技术,解决超大芯片散热难题,支持高密度集群部署。

- 软件生态:配套 CS-3 系统简化大模型训练流程,代码量较 GPU 减少约 50%。

二、行业对比与应用场景

- 对标英伟达 H100

- 晶体管数量:WSE-3(4 万亿)是 H100(800 亿)的 50 倍;

- 片上存储:44GB SRAM 是 H100(80GB HBM3)的 880 倍(按片上 / 板载内存计算);

- 互连效率:单芯片内数据传输延迟仅为跨 GPU 集群的 1/100。

- 超级计算机部署

- Condor Galaxy 3:美国达拉斯在建的超级计算机将搭载 64 个 CS-3 系统(含 WSE-3 芯片),总算力达 8 exaFLOPs,预计 2024 年底完工。

- 全球算力排名:若与现有 Condor Galaxy 1/2 集群联合,总算力将达 16 exaFLOPs,超越当前全球最快超算 “前沿”(1 exaFLOPs)。

- 应用领域

- 大模型训练:支持生成式 AI、蛋白质结构预测等超大规模计算任务;

- 边缘计算:与高通合作开发推理加速器,拓展端侧应用。

三、行业影响与专家评价

- 技术里程碑

- Cerebras CEO Andrew Feldman 称:“WSE-3 是摩尔定律的真正延续,在相同功耗和成本下性能翻倍。”

- 分析机构 Intersect360 Research 指出,WSE-3 的单芯片架构为高算力需求场景提供了 “更简单、更高效” 的解决方案。

- 市场挑战

- 尽管性能领先,WSE-3 仍面临生态壁垒。Tirias Research 分析师 Jim McGregor 认为:“英伟达的 CUDA 生态短期内难以替代,Cerebras 需在特定领域(如大模型训练)建立差异化优势。”

- 目前 WSE-3 供应有限,Cerebras 计划 2024 年完成总价值超 10 亿美元的集群部署,覆盖美国多地。

© 版权声明

本站内容文章版权归作者所有,未经允许请勿转载,如转载必须注明出处。

THE END

暂无评论内容